«`html

Оптимизация обучения больших языковых моделей с помощью Adam-mini

Исследование сосредотачивается на оптимизации алгоритмов обучения больших языковых моделей (LLM), которые необходимы для понимания и генерации человеческого языка. Эти модели критически важны для различных приложений, включая обработку естественного языка и искусственный интеллект. Обучение LLM требует значительных вычислительных ресурсов и памяти, поэтому оптимизация этих процессов является приоритетной задачей для исследователей.

Проблема

Основная проблема, рассматриваемая в данной статье, заключается в высоком требовании к памяти оптимизационных алгоритмов, используемых при обучении больших языковых моделей. Например, оптимизатор Adam, стандарт в этой области из-за своей высокой производительности, требует значительного объема памяти для хранения состояний оптимизатора, таких как значения первого и второго порядков импульсов. Это удвоение потребности в памяти создает значительную нагрузку, делая обучение больших моделей дорогостоящим и менее доступным для исследователей с ограниченными ресурсами.

Решение

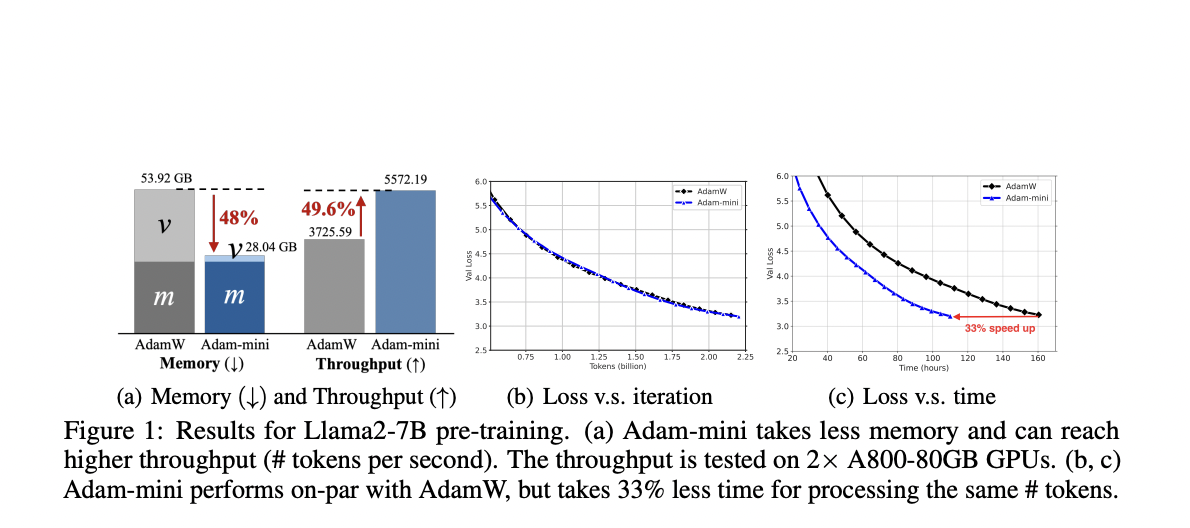

Исследователи из Китайского университета Гонконга, Шэньчжэньского исследовательского института больших данных, университета Дьюка и Стэнфордского университета представили Adam-mini, оптимизатор, разработанный для достижения схожей или даже лучшей производительности по сравнению с Adam при снижении использования памяти на 45% — 50%. Adam-mini достигает этого путем разделения параметров модели на блоки на основе гессианской структуры трансформеров. Каждому блоку затем назначается один высококачественный коэффициент обучения, что значительно снижает количество коэффициентов обучения с миллиардов до управляемого числа. Такой подход позволяет Adam-mini сохранять или даже улучшать производительность с долей памяти, необходимой для Adam.

Заключение

Оптимизатор Adam-mini решает значительные проблемы с памятью традиционных методов оптимизации, таких как Adam, представляя новую стратегию разделения на основе гессианской структуры моделей. Этот инновационный подход приводит к существенной экономии памяти и улучшенной эффективности обучения, делая его ценным инструментом для исследователей, работающих с масштабными языковыми моделями.

Подробнее о статье можно узнать здесь.

Вся заслуга за это исследование принадлежит его авторам.

Не забудьте подписаться на наш Twitter.

Присоединяйтесь к нашему каналу в Telegram и группе в LinkedIn.

Если вам понравилась наша работа, вам понравится и наша рассылка.

Не забудьте присоединиться к нашему Reddit с более чем 45 000 подписчиков.

Использование ИИ в продажах и маркетинге

Если вы хотите, чтобы ваша компания развивалась с помощью искусственного интеллекта (ИИ) и оставалась в числе лидеров, грамотно используйте Adam-mini: A Memory-Efficient Optimizer Revolutionizing Large Language Model Training with Reduced Memory Usage and Enhanced Performance.

Практические рекомендации

Проанализируйте, как ИИ может изменить вашу работу. Определите, где возможно применение автоматизации: найдите моменты, когда ваши клиенты могут извлечь выгоду из AI.

Определитесь, какие ключевые показатели эффективности (KPI) вы хотите улучшить с помощью ИИ.

Подберите подходящее решение, сейчас очень много вариантов ИИ. Внедряйте ИИ решения постепенно: начните с малого проекта, анализируйте результаты и KPI.

На полученных данных и опыте расширяйте автоматизацию.

Если вам нужны советы по внедрению ИИ, пишите нам на Telegram.

Следите за новостями о ИИ в нашем Телеграм-канале t.me/itinainews или в Twitter itinairu45358.

Попробуйте AI Sales Bot. Этот AI ассистент в продажах помогает отвечать на вопросы клиентов, генерировать контент для отдела продаж, снижать нагрузку на первую линию.

Узнайте, как ИИ может изменить ваши процессы с решениями от AI Lab itinai.ru. Будущее уже здесь!

«`