«`html

Новые возможности в области языковых моделей

Недавние достижения в области языковых моделей (LLM) увеличили их применимость, позволяя выполнять более широкий спектр задач автономно. Однако существующие методы программирования и выполнения LLM-программ могут быть более эффективными. Сталкиваются с проблемами эффективного использования LLM-программ: недетерминированный характер LLM делает программирование сложным и утомительным. Комплексность разработки ПО для LLM включает в себя параллельные механизмы, работу с различными входными модальностями, хрупкий анализ вывода, экспериментальную настройку подсказок и обширную манипуляцию строками. Эта сложность значительно снижает читаемость даже самых базовых приложений. Во-вторых, выполнение программ LLM приводит к избыточному расходу памяти и вычислительных ресурсов из-за избыточных вычислений.

Решение проблем

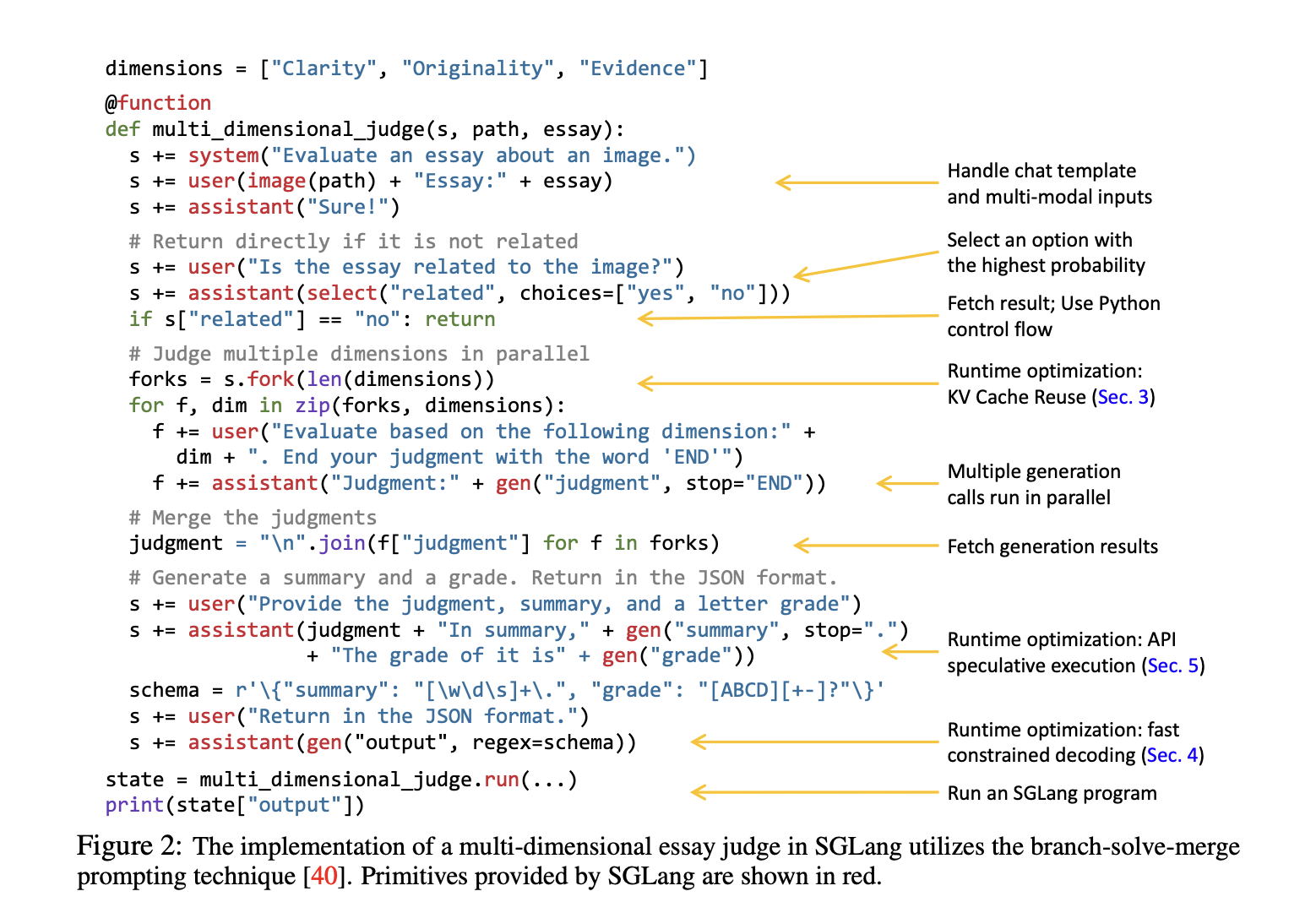

Группа исследователей из университетов Стэнфорда, UC Berkeley, Шанхайского университета Цзяотун и Техасского университета A&M представила SGLang, язык структурированной генерации для LLM, чтобы решить эти проблемы. Основная идея заключается в использовании многократной структуры программ LLM систематическим образом для ускорения их выполнения. Эта система включает язык для фронтенда и среду выполнения для бэкенда. При этом среда выполнения ускоряет выполнение программ LLM, а фронтенд упрощает программирование LLM-программ. Обе компоненты могут работать отдельно или в совокупности для оптимальной производительности. Предоставляются примитивы для управления параллелизмом (разветвление и объединение) и генерацией (расширение, генерация и выбор). Поскольку SGLang работает с библиотеками Python и потоком управления, пользователи могут легко создавать сложные процессы подсказки с использованием естественного синтаксиса языка.

Команда также представила компилятор и интерпретатор для SGLang. Путем правильного управления синхронизацией и внутрипрограммным параллелизмом интерпретатор обеспечивает отправку примитивных операций в поток для асинхронного выполнения и управление состоянием подсказки как потоком. Дополнительные оптимизации могут быть достигнуты путем трассировки и компиляции программы SGLang. Для ускорения выполнения приложений SGLang исследователи предлагают несколько новых оптимизаций с точки зрения среды выполнения.

Компактный конечный автомат является вторым методом, который позволяет более быстро выполнять ограниченное декодирование структурированных выводов. Наконец, модель только с API, такая как GPT-4 от OpenAI, может быть оптимизирована для многократных программ с использованием SGLang.

Оценка производительности

Исходя из экспериментальных результатов, SGLang превосходит существующие системы программирования и вывода на 6,4% при различных рабочих нагрузках, моделях и конфигурациях оборудования.

Дальнейшие улучшения

Несмотря на достигнутые результаты, SGLang все еще имеет ограничения, которые указывают на интересные направления для дальнейших исследований. Среди улучшений добавление поддержки для большего количества выходных модальностей, работа RadixAttention на разных уровнях иерархии памяти, добавление более высокоуровневых примитивов в SGLang и улучшение компилятора SGLang в плане планирования и оптимизации памяти.

Ссылки и контакты

Подробнее о проекте можно узнать в оригинальной статье и на GitHub. Следите за новостями в нашем Телеграм-канале и на Twitter. Присоединяйтесь к нам, чтобы быть в курсе последних новостей в области искусственного интеллекта.

AI Sales Bot

Попробуйте AI Sales Bot, который поможет вам в области продаж, снижая нагрузку на первую линию и генерируя контент для отдела продаж.

AI Lab itinai.ru

Узнайте, как решения AI Lab itinai.ru могут изменить ваши процессы с использованием искусственного интеллекта.

AI Webinars

Узнайте о предстоящих вебинарах по искусственному интеллекту.

«`