«`html

Большие языковые модели (LLM) в области извлечения информации

Большие языковые модели (LLM) сделали значительные успехи в области извлечения информации (IE). Извлечение информации — это задача в обработке естественного языка (NLP), которая включает в себя идентификацию и извлечение конкретной информации из текста. LLM продемонстрировали отличные результаты в IE, особенно при совмещении с инструкционной настройкой. Через инструкционную настройку эти модели обучаются аннотировать текст в соответствии с заранее определенными стандартами, что улучшает их способность к обобщению на новые наборы данных. Это указывает на то, что даже с неизвестными данными люди могут успешно выполнять задачи IE, следуя инструкциям.

Проблемы LLM при работе с языками с ограниченными ресурсами

Однако, даже с этими улучшениями, LLM все еще сталкиваются с множеством трудностей при работе с языками с ограниченными ресурсами. Эти языки лишены как неразмеченного текста, необходимого для предварительного обучения, так и размеченных данных, необходимых для настройки моделей. Из-за отсутствия данных для LLM сложно достичь хороших результатов в этих языках.

Решение проблемы с помощью TransFusion

Для преодоления этой проблемы команда исследователей из Института технологий Джорджии представила фреймворк TransFusion. В TransFusion модели настраиваются на работу с данными, переведенными из языков с ограниченными ресурсами на английский. С помощью этого метода оригинальный текст на языке с ограниченными ресурсами и его английский перевод предоставляют информацию, которую модели могут использовать для создания более точных прогнозов.

Основные шаги в рамках TransFusion

Фреймворк включает три основных шага:

- Перевод в процессе вывода: преобразование данных на языке с ограниченными ресурсами на английский, чтобы модель с высокими ресурсами могла проаннотировать их.

- Слияние аннотированных данных: в модели, обученной использовать оба типа данных, слияние оригинального текста на языке с ограниченными ресурсами с аннотированными английскими переводами.

- Создание цепочки рассуждений TransFusion, которая интегрирует как аннотацию, так и слияние в один авторегрессивный проход.

GoLLIE-TF и эксперименты

Команда также представила GoLLIE-TF, инструкционно настроенную LLM, которая является кросс-языковой и специально адаптирована для задач Internet Explorer. Цель TransFusion и GoLLIE-TF — увеличить эффективность LLM при работе с языками с ограниченными ресурсами. Эксперименты на двенадцати мультиязычных наборах данных по IE, включающих пятьдесят языков, показали, что GoLLIE-TF работает хорошо. По сравнению с базовой моделью результаты демонстрируют, что GoLLIE-TF обладает большей переносимостью между языками без дополнительных данных для обучения.

Применение TransFusion к собственным моделям

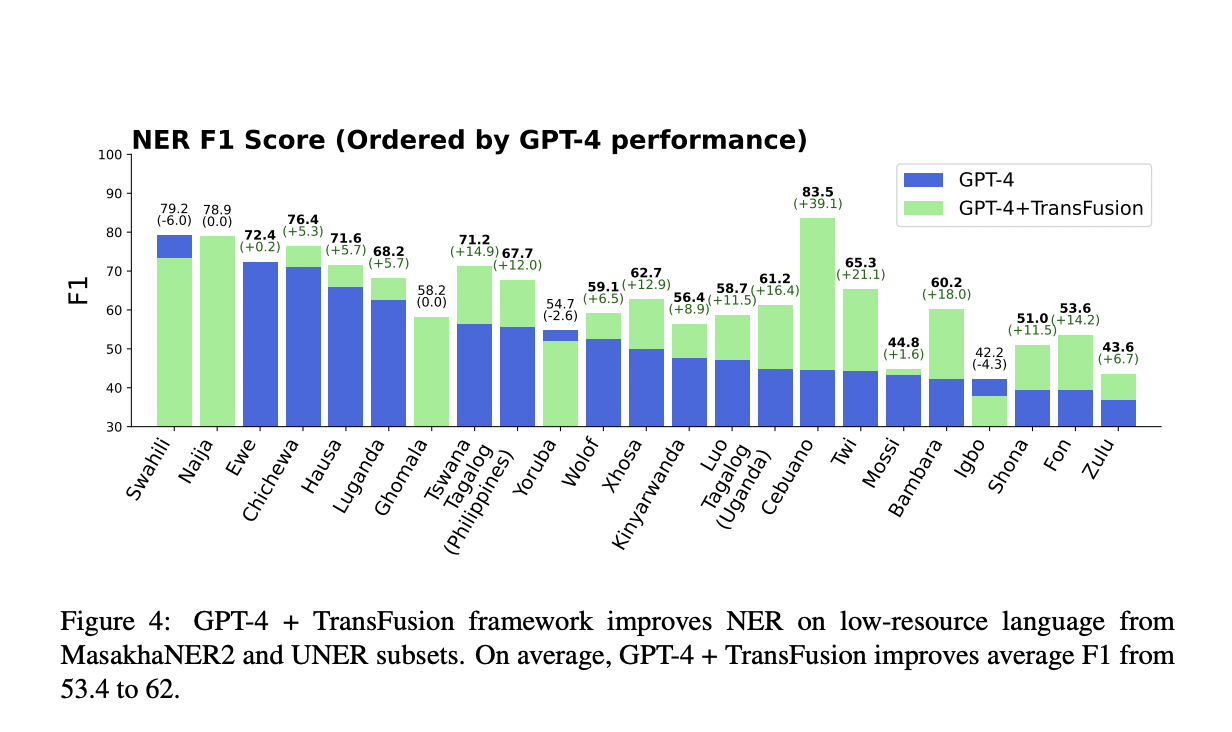

TransFusion значительно улучшает производительность распознавания именованных сущностей (NER) на языках с ограниченными ресурсами, таких как GPT-4. При использовании запросов производительность GPT-4 увеличилась на 5 F1-пунктов. Дополнительные улучшения были получены путем настройки различных типов языковых моделей с использованием фреймворка TransFusion: архитектуры только декодера улучшились на 14 F1-пунктов, а только кодировщика — на 13 F1-пунктов.

Заключение

TransFusion и GoLLIE-TF вместе предоставляют мощное решение для улучшения задач IE на языках с ограниченными ресурсами. Это позволяет значительно улучшить производительность моделей и снизить разрыв в производительности между языками с высокими и ограниченными ресурсами путем использования английских переводов и настройки моделей для слияния аннотаций.

Подробнее ознакомьтесь с статьей. Все заслуги за это исследование принадлежат исследователям этого проекта. Также не забудьте подписаться на наш Twitter.

Присоединяйтесь к нашему Telegram-каналу и группе в LinkedIn.

Если вам нравится наша работа, вам понравится наша рассылка.

Не забудьте присоединиться к нашему 45k+ ML SubReddit.

Оригинал статьи: TransFusion: An Artificial Intelligence AI Framework To Boost a Large Language Model’s Multilingual Instruction-Following Information Extraction Capability.

«`