«`html

Оптимизация понимания документов с помощью DocOwl2: Новая архитектура сжатия высокого разрешения

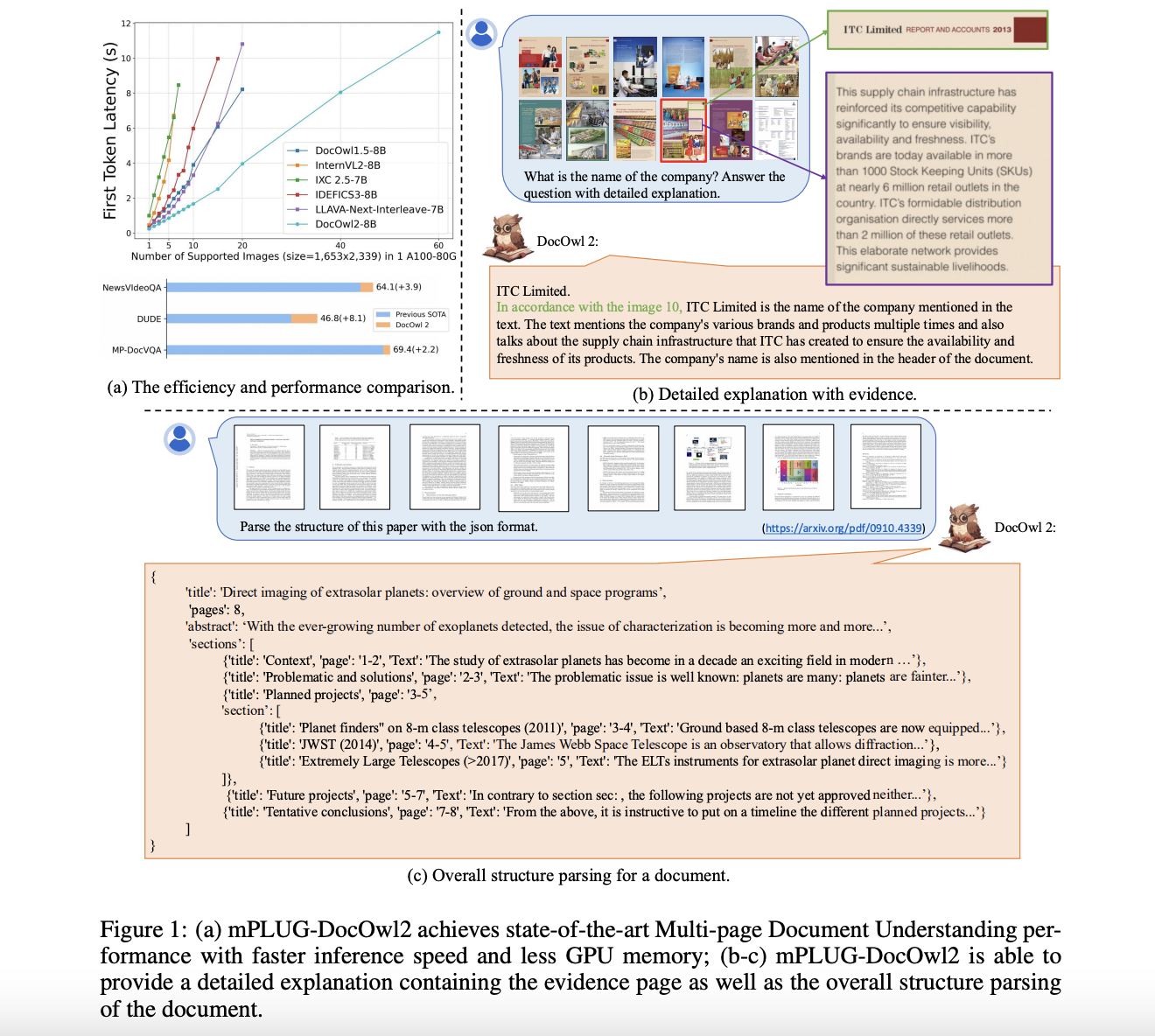

Понимание многостраничных документов и новостных видеороликов — это обычная задача в повседневной жизни человека. Для решения таких сценариев мультимодальные большие языковые модели (MLLMs) должны быть оснащены способностью понимать несколько изображений с богатой визуально-ориентированной текстовой информацией. Однако понимание изображений документов более сложно, чем естественные изображения, поскольку требует более детального восприятия для распознавания всех текстов. Существующие подходы либо добавляют высокоразрешающий кодер, либо обрезают изображения высокого разрешения на низкоразрешающие подизображения, оба из которых имеют ограничения.

Решения для понимания документов

Предыдущие исследователи пытались решить проблему понимания изображений документов с помощью различных техник. Некоторые работы предложили добавление высокоразрешающего кодера для более точного захвата текстовой информации в изображениях документов. Другие выбрали обрезку изображений высокого разрешения на низкоразрешающие подизображения и позволили большой языковой модели понять их взаимосвязь.

Хотя эти подходы показали многообещающие результаты, они сталкиваются с общей проблемой — большое количество визуальных токенов, необходимых для представления одного изображения документа. Например, модель InternVL 2 требует в среднем 3 тыс. визуальных токенов на одностраничном бенчмарке понимания документов DocVQA. Такие длинные последовательности визуальных токенов не только приводят к длительным временам вывода, но и занимают значительное количество памяти GPU, что сильно ограничивает их применение в сценариях, связанных с пониманием полных документов или видеороликов.

Архитектура High-resolution DocCompressor

Исследователи из Alibaba Group и Ренминского университета Китая предложили надежную архитектуру сжатия под названием High-resolution DocCompressor. Этот метод использует визуальные особенности глобального низкоразрешающего изображения в качестве руководства для сжатия (запрос), поскольку глобальная карта особенностей может эффективно захватывать общую информацию о макете документа.

Вместо того чтобы обращаться ко всем высокоразрешающим особенностям, High-resolution DocCompressor собирает группу высокоразрешающих особенностей с идентичными относительными положениями на исходном изображении в качестве сжимаемых объектов для каждого запроса из глобальной карты особенностей. Такой подход, ориентированный на макет, помогает лучше суммировать текстовую информацию в конкретном регионе макета.

Кроме того, исследователи утверждают, что сжатие визуальных особенностей после модуля отображения в тексте мультимодальной большой языковой модели может лучше сохранить текстовую семантику в изображениях документов, поскольку это аналогично суммированию текстов в обработке естественного языка.

Модель DocOwl2 и результаты исследований

Модель DocOwl2 использует модуль кроппинга с адаптивной формой и низкоразрешающий визионный кодер для кодирования изображений документов высокого разрешения. Модуль кроппинга с адаптивной формой разделяет исходное изображение на несколько низкоразрешающих подизображений, а низкоразрешающий визионный кодер используется для кодирования как подизображений, так и глобального изображения. Затем модель использует модуль отображения в тексте под названием H-Reducer для объединения горизонтальных визуальных особенностей и выравнивания размерности визионных особенностей с большой языковой моделью. Кроме того, DocOwl2 включает высокоразрешающий сжиматель, который является ключевым компонентом High-resolution DocCompressor. Этот сжиматель использует визуальные особенности глобального низкоразрешающего изображения в качестве запроса и собирает группу высокоразрешающих особенностей с идентичными относительными положениями на исходном изображении в качестве сжимаемых объектов для каждого запроса. Такой подход, ориентированный на макет, помогает лучше суммировать текстовую информацию в конкретном регионе макета. Наконец, сжатые визуальные токены нескольких изображений или страниц объединяются с текстовыми инструкциями и вводятся в большую языковую модель для мультимодального понимания.

Исследователи сравнили модель DocOwl2 с передовыми мультимодальными большими языковыми моделями на 10 одностраничных бенчмарках понимания документов, 2 бенчмарках понимания многостраничных документов и 1 бенчмарке понимания текстового видео. Они учитывали как производительность в вопросно-ответной системе (измеряемую по ANLS), так и первую задержку токена (в секундах), чтобы оценить эффективность своей модели. Для задачи понимания одностраничных документов исследователи разделили базовые значения на три группы: (а) модели без больших языковых моделей в качестве декодеров, (б) мультимодальные LLM с более чем 1 000 визуальными токенами на каждое изображение документа и (в) мультимодальные LLM с менее чем 1 000 визуальными токенами.

Результаты показывают, что, хотя модели, специально настроенные на каждый нижестоящий набор данных, показали себя хорошо, мультимодальные LLM продемонстрировали потенциал для обобщенного понимания документов без OCR. По сравнению с другими мультимодальными LLM с менее чем 1 000 визуальными токенами модель DocOwl2 показала лучшие или сопоставимые результаты на 10 бенчмарках. Заметно, что при меньшем количестве визуальных токенов DocOwl2 превзошла модели, такие как TextMonkey и TokenPacker, которые также стремились сжать визуальные токены, демонстрируя эффективность High-resolution DocCompressor.

Также по сравнению с передовыми мультимодальными LLM с более чем 1 000 визуальными токенами модель DocOwl2 достигла более чем 80% их производительности, используя менее чем 20% визуальных токенов. Для задач понимания многостраничных документов и понимания текстового видео модель DocOwl2 также продемонстрировала превосходную производительность и значительно меньшую первую задержку токена по сравнению с другими мультимодальными LLM, которым можно передать более 10 изображений на одном графическом процессоре A100-80G.

Это исследование представляет mPLUG-DocOwl2, мультимодальную большую языковую модель, способную к эффективному пониманию многостраничных документов без OCR. Надежная архитектура High-resolution DocCompressor сжимает каждое изображение документа высокого разрешения всего до 324 токенов с использованием кросс-внимания с глобальными визуальными особенностями в качестве руководства. На бенчмарках одностраничных изображений DocOwl2 превосходит существующие методы сжатия и соответствует передовым мультимодальным LLM, используя меньше визуальных токенов. Он также достигает передовой производительности без OCR в задачах понимания многостраничных документов и текстового видео с гораздо более низкой задержкой. Исследователи подчеркивают, что использование тысяч визуальных токенов на страницу документа часто излишне и является расточительством вычислительных ресурсов. Они надеются, что DocOwl2 привлечет внимание к балансировке эффективного представления изображения и высокопроизводительного понимания документов.

Подписывайтесь на наш канал

Если вам нравится наша работа, вам понравится наша рассылка. Не забудьте подписаться на наш канал в Telegram. Присоединяйтесь к нашему Telegram-каналу, чтобы быть в курсе последних новостей в области искусственного интеллекта.

«`