«`html

Large Language Models (LLMs) в AI индустрии

Проблема

Large Language Models (LLMs) становятся все более популярными в AI индустрии, однако эффективное обслуживание нескольких LLMs становится серьезной проблемой для поставщиков. Основная проблема заключается в значительных вычислительных требованиях этих моделей, что требует мощных ресурсов.

Существующие решения

Существующие попытки решить проблемы обслуживания LLM включают в себя различные подходы, такие как системы глубокого обучения, кастомизированные ядра GPU, техники параллелизации и оптимизации памяти. Однако существующие методы не решают проблему эффективного обслуживания нескольких LLMs.

Решение

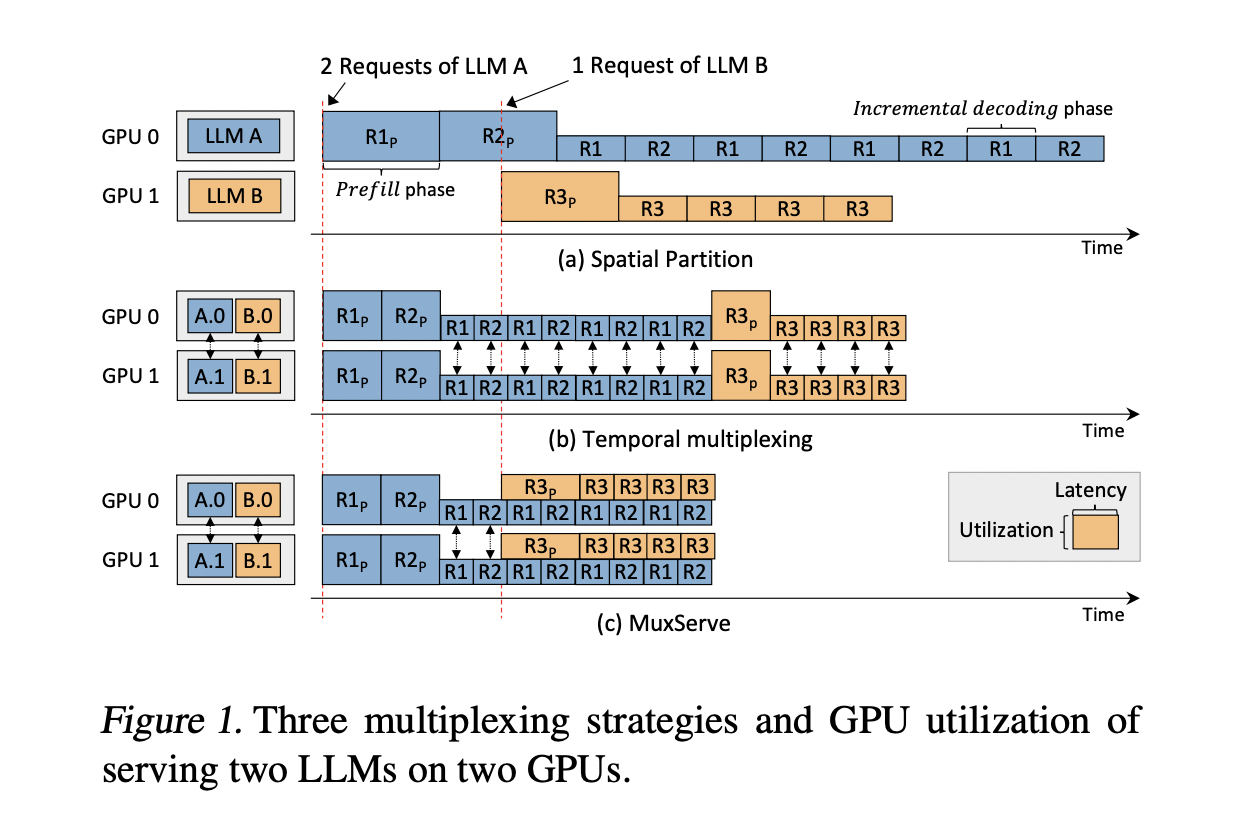

MuxServe представляет собой гибкий пространственно-временной мультиплексный подход для обслуживания нескольких LLMs, решающий проблемы использования GPU ресурсов. Система использует жадный алгоритм размещения, адаптивное планирование пакетов и унифицированный менеджер ресурсов для максимизации эффективности.

Преимущества

MuxServe демонстрирует улучшенную производительность как в синтетических, так и в реальных рабочих нагрузках, превосходя существующие системы. Система способна эффективно совмещать LLMs с различным уровнем популярности, улучшая использование ресурсов системы.

Заключение

MuxServe представляет собой значительное достижение в области обслуживания LLM. Система способна эффективно совмещать несколько LLMs, отвечая вызовам современной индустрии AI и предоставляя перспективное решение для эффективного и масштабируемого обслуживания LLM.

Подробнее о проекте и исследовании можно узнать по ссылке [ссылка на проект].

Подписывайтесь на наш Телеграм-канал и LinkedIn группу для обновлений.

«`