«`html

Улучшение моделей Transformer с помощью SSMax

Модели на основе трансформеров обрабатывают текст, анализируя взаимосвязи между словами, а не читая в порядке. Они используют механизмы внимания для фокусировки на ключевых словах, но работать с длинными текстами им сложно.

Проблема с вниманием

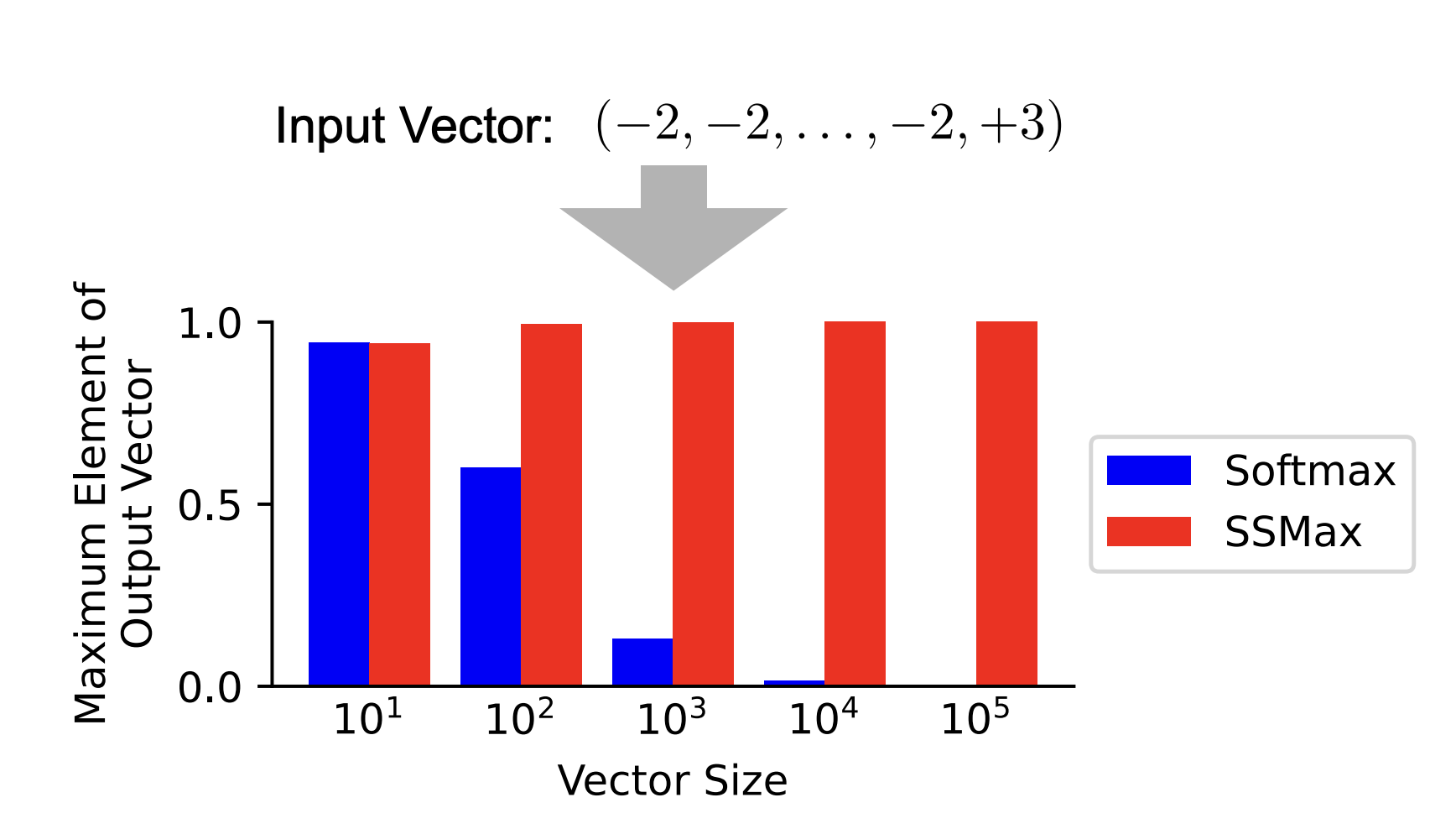

Функция Softmax, которая распределяет внимание, теряет эффективность при увеличении объема входных данных, что приводит к ослаблению внимания. Это уменьшает способность модели сосредотачиваться на важных словах, делая обучение на длинных текстах сложным.

Решения для улучшения

Существующие методы, такие как позиционное кодирование, разреженное внимание и расширенное обучение на длинных текстах, требуют значительных вычислительных ресурсов и не масштабируемы.

Введение SSMax

Чтобы справиться с проблемой ослабления внимания, исследователь из Токийского университета предложил Scalable-Softmax (SSMax). Эта модификация функции Softmax позволяет сохранять внимание на важных токенах, даже когда размер входных данных увеличивается. SSMax адаптирует коэффициент масштабирования в зависимости от размера входных данных, что позволяет сохранять акцент на ключевой информации.

Эффективность SSMax

Исследования показали, что SSMax значительно повышает эффективность обучения и обобщение на длинных контекстах. Модели с SSMax показывают лучшие результаты в извлечении ключевой информации из длинных текстов.

Практические рекомендации для бизнеса

Если вы хотите, чтобы ваша компания развивалась с помощью искусственного интеллекта (ИИ), используйте подходы, подобные SSMax. Вот несколько шагов:

- Проанализируйте, как ИИ может изменить вашу работу.

- Определите ключевые показатели эффективности (KPI), которые хотите улучшить.

- Подберите подходящее ИИ-решение и внедряйте его постепенно.

- Расширяйте автоматизацию на основе полученных данных и опыта.

Если вам нужны советы по внедрению ИИ, пишите нам в Telegram. Узнайте, как ИИ может изменить процесс продаж в вашей компании с решениями от Saile.ru. Будущее уже здесь!

«`