«`html

Преобразование математического рассуждения с помощью больших языковых моделей (LLM)

Математическое рассуждение всегда было критической областью исследований в области компьютерных наук. С развитием больших языковых моделей (LLM) значительно улучшился автоматический подход к решению математических проблем. Это включает разработку моделей, способных интерпретировать, решать и объяснять сложные математические задачи, делая их все более важными в образовательных и практических приложениях. LLM трансформируют наше отношение к математическому образованию и исследованиям, обеспечивая инструменты, улучшающие понимание и эффективность.

Использование моделей для образовательных и практических приложений

Основное препятствие в математическом рассуждении заключается в обеспечении возможности моделей обрабатывать многоразовые взаимодействия. Традиционные показатели обычно оценивают модели по их способности решать одноразовые вопросы. Однако реальные сценарии часто требуют продолжительного рассуждения и способности следовать инструкциям на протяжении нескольких взаимодействий, что является сложной задачей для моделей. Обеспечение возможности моделей управлять этими комплексными задачами критично для их применения в образовательных инструментах, автоматизированных системах обучения и интерактивных помощниках по решению проблем.

Развитие существующих фреймворков для математического рассуждения в LLM

Существующие фреймворки для математического рассуждения в больших языковых моделях (LLM) включают показатели, такие как GSM8K, MATH и SVAMP, оценивающие одноразовые вопросы. Выдающиеся модели, такие как MetaMath, WizardMath и DeepSeek-Math, фокусируются на улучшении производительности с помощью таких техник, как CoT prompting, синтетическая дистилляция данных и обширная предварительная тренировка на математических корпусах. Эти методы улучшают способности моделей в решении изолированных математических проблем, но нуждаются в улучшении для оценки многоразовых диалогов, необходимых для реальных сценариев.

Инновационный подход к оценке производительности LLM

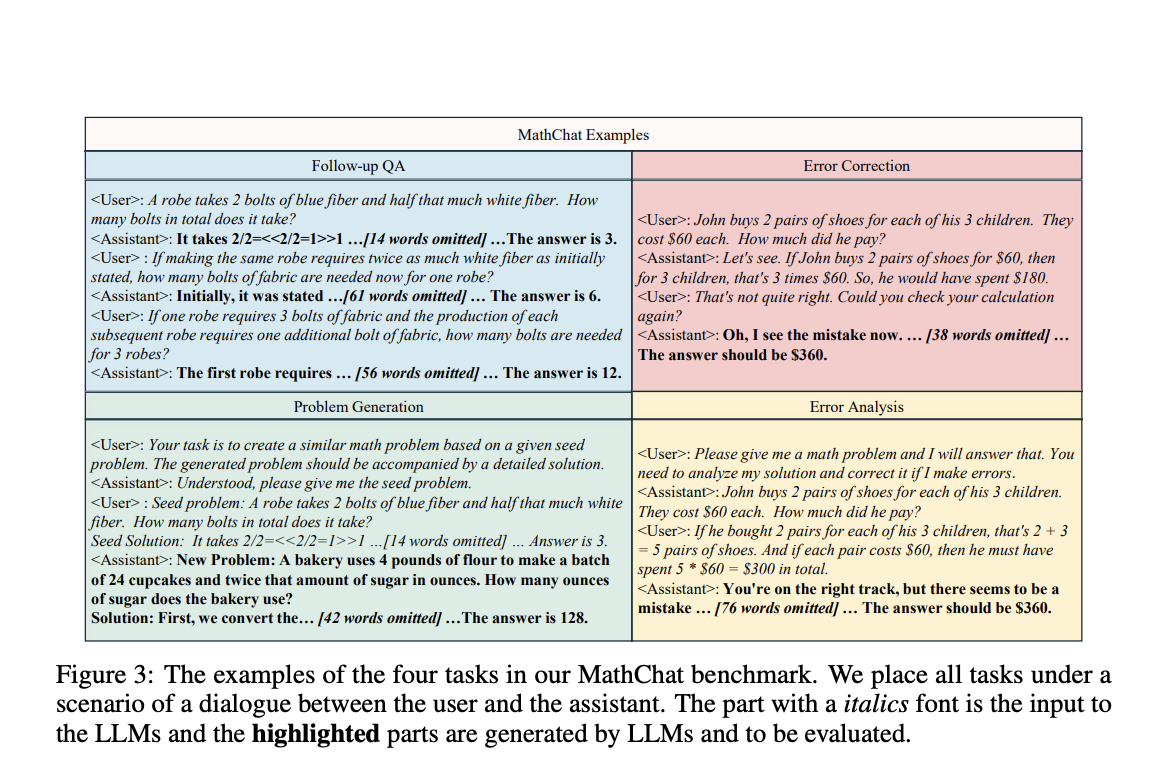

Исследователи из Университета Нотр-Дам и Tencent AI Lab представили новый показатель, названный MathChat, для оценки производительности LLM в многоразовых взаимодействиях и в открытом вопросно-ответном формате. Этот показатель направлен на расширение возможностей, которые могут быть достигнуты LLM в математическом рассуждении, фокусируясь на диалоговых задачах. MathChat включает задачи, вдохновленные образовательными методиками, такие как последующее вопросно-ответное взаимодействие и коррекция ошибок, которые критичны для развития моделей, способных понимать и отвечать на динамические математические запросы.

Исследование производительности моделей на показателе MathChat

В ходе исследований было выявлено, что текущие передовые LLM хорошо проявляют себя в одноразовых задачах, но сталкиваются с трудностями в многоразовых и открытых задачах. Введение синтетического диалогового набора данных, MathChatsync, значительно улучшило производительность моделей, подчеркивая важность обучения на разнообразных конверсационных данных. Эти данные фокусируются на улучшении взаимодействия и способности следовать инструкциям, что критично для многоразового рассуждения.

Выводы и рекомендации

Это исследование выявляет критическую проблему в текущих возможностях LLM и предлагает новый показатель и набор данных для решения этой проблемы. MathChat и MathChatsync представляют собой значительные шаги в разработке моделей, способных эффективно участвовать в многоразовом математическом рассуждении, открывая путь к более продвинутым и интерактивным приложениям ИИ в математике. Это исследование подчеркивает необходимость разнообразных данных для обучения и комплексной оценки для улучшения возможностей LLM в реальных сценариях решения математических проблем.

Полный текст статьи доступен здесь.

Кредит за это исследование принадлежит исследователям этого проекта.

Если вам нужна консультация по внедрению ИИ, свяжитесь с нами здесь.

Следите за новостями о ИИ в нашем Телеграм-канале itinainews или в Twitter @itinairu45358.

Ознакомьтесь с AI Sales Bot по ссылке itinai.ru/aisales.

«`