«`html

Training on a Dime: MEFT Achieves Performance Parity with Reduced Memory Footprint in LLM Fine-Tuning

Большие языковые модели (LLM) становятся все более важными в обработке естественного языка, поскольку они способны выполнять широкий спектр задач с высокой точностью. Однако процесс их настройки требует значительных вычислительных ресурсов и памяти.

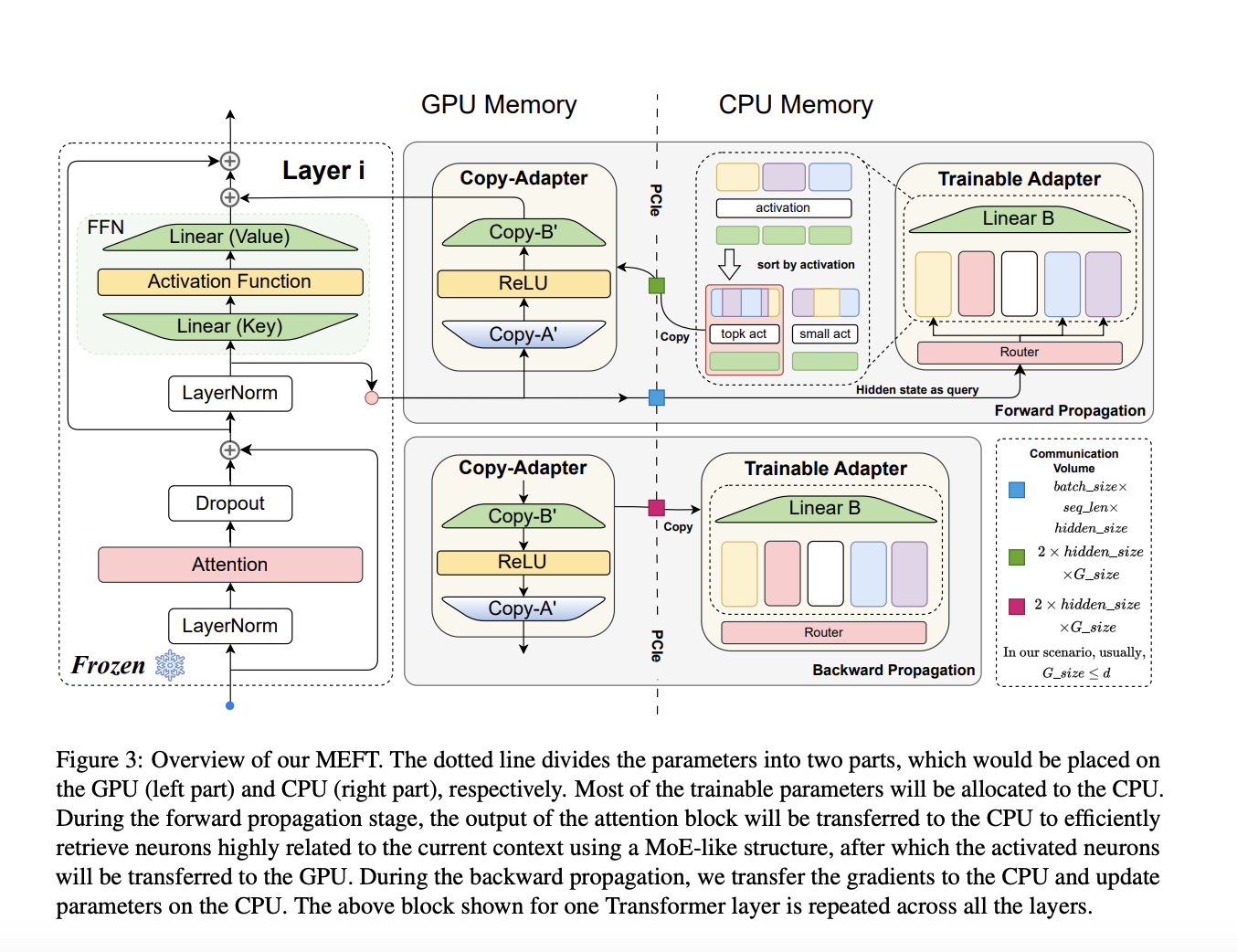

Решение: Метод MEFT предлагает эффективное решение для уменьшения использования памяти и ресурсов при настройке LLM, обеспечивая при этом сравнимую с полной настройкой производительность.

Преимущества MEFT:

- Существенное уменьшение использования памяти GPU

- Высокая производительность на различных наборах данных

- Способность обрабатывать сложные задачи естественного языка

Для получения полной информации о методе MEFT прочитайте статью.

Если вы хотите внедрить искусственный интеллект в свою компанию, обращайтесь к нам. Мы поможем вам выбрать оптимальное решение и проанализировать эффективность его внедрения.

Попробуйте AI Sales Bot — интеллектуального бота для увеличения эффективности работы вашего отдела продаж.

Для консультаций по внедрению ИИ пишите нам на Telegram. Следите за новостями о ИИ в нашем Телеграм-канале и на Twitter.

«`