«`html

Современные глубокие нейронные сети (DNN) непрозрачны по своей природе; мы не знаем, как и почему эти компьютеры приходят к таким прогнозам. Это является основным барьером для более широкого использования техник машинного обучения во многих областях. Возникла область изучения под названием Explainable AI (XAI), которая появилась, чтобы прояснить, как DNN принимают решения таким образом, чтобы их могли понять люди.

Практические решения и ценность:

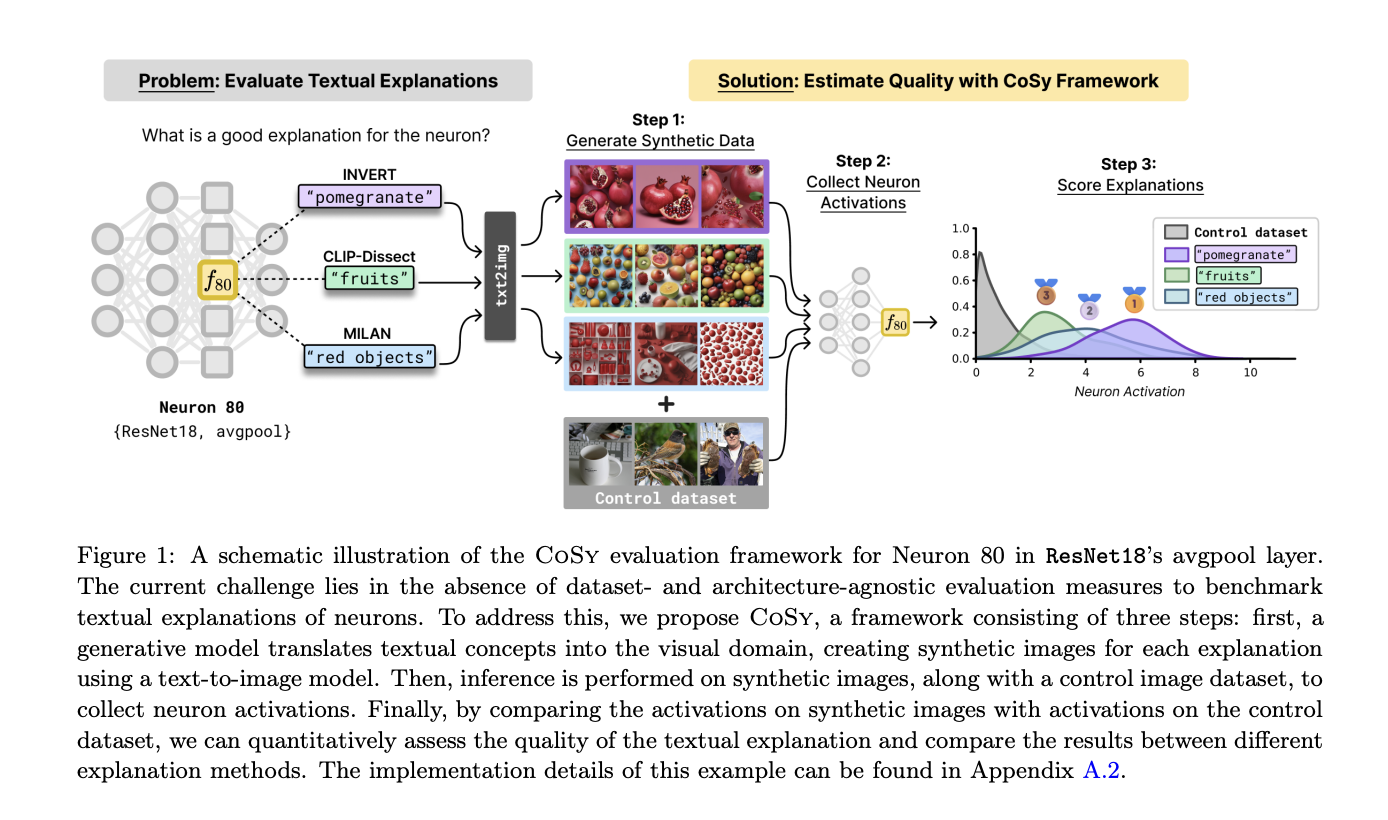

CoSy — инновационный метод оценки качества текстовых объяснений для скрытых нейронов, который позволяет создавать синтетические визуальные представления, соответствующие данным текстовым описаниям. Это позволяет сравнивать несколько методов текстовых объяснений и тестировать их, используя активации нейронов, без необходимости человеческого вмешательства.

CoSy обеспечивает точную оценку объяснений, демонстрируя, что методы текстовых объяснений на основе концепций лучше всего применять на последних уровнях, где происходит обучение высокоуровневых концепций. Это позволяет избежать неправильных выводов о сети.

Оценочная модель CoSy пока имеет свои недостатки, но исследователи уверены в ее будущем применении в различных областях, таких как здравоохранение и обработка естественного языка. Применение CoSy к наборам данных в здравоохранении может быть значительным шагом вперед.

Если вы хотите узнать больше о CoSy, ознакомьтесь с нашей статьей. Следите за нашими новостями в Twitter и присоединяйтесь к нашему Telegram-каналу.

Если вам нужна помощь во внедрении ИИ, обращайтесь к нам на Telegram. Попробуйте нашего AI Sales Bot, который поможет вам снизить нагрузку на первую линию и улучшить обслуживание клиентов: itinai.ru/aisales.

Узнайте, как решения от AI Lab itinai.ru могут изменить ваши процессы — будущее уже здесь!

«`