«`html

Модели пространства состояний (SSM) в глубоком обучении для моделирования последовательностей

Модели пространства состояний (SSM) играют важную роль в глубоком обучении для моделирования последовательностей. Они представляют системы, в которых выход зависит как от текущих, так и от прошлых входов. SSM широко применяются в обработке сигналов, системах управления и обработке естественного языка. Основной вызов заключается в неэффективности существующих SSM, особенно в отношении затрат памяти и вычислительных ресурсов. Традиционные SSM требуют большей сложности и использования ресурсов по мере роста состояния, что ограничивает их масштабируемость и производительность в крупномасштабных приложениях.

Решения и практические применения

Существующие исследования включают в себя такие фреймворки, как S4 и S4D, которые используют диагональные представления пространства состояний для управления сложностью. Методы, основанные на быстром преобразовании Фурье (FFT), используются для эффективной параллельности последовательностей. Трансформеры революционизировали моделирование последовательностей с механизмами самовнимания, в то время как Hyena включает сверточные фильтры для долгосрочных зависимостей. Liquid-S4 и Mamba оптимизируют моделирование последовательностей через выборочные пространства состояний и управление памятью. Бенчмарк Long Range Arena является стандартом для оценки производительности моделей на длинных последовательностях. Эти достижения улучшают эффективность и возможности моделирования последовательностей.

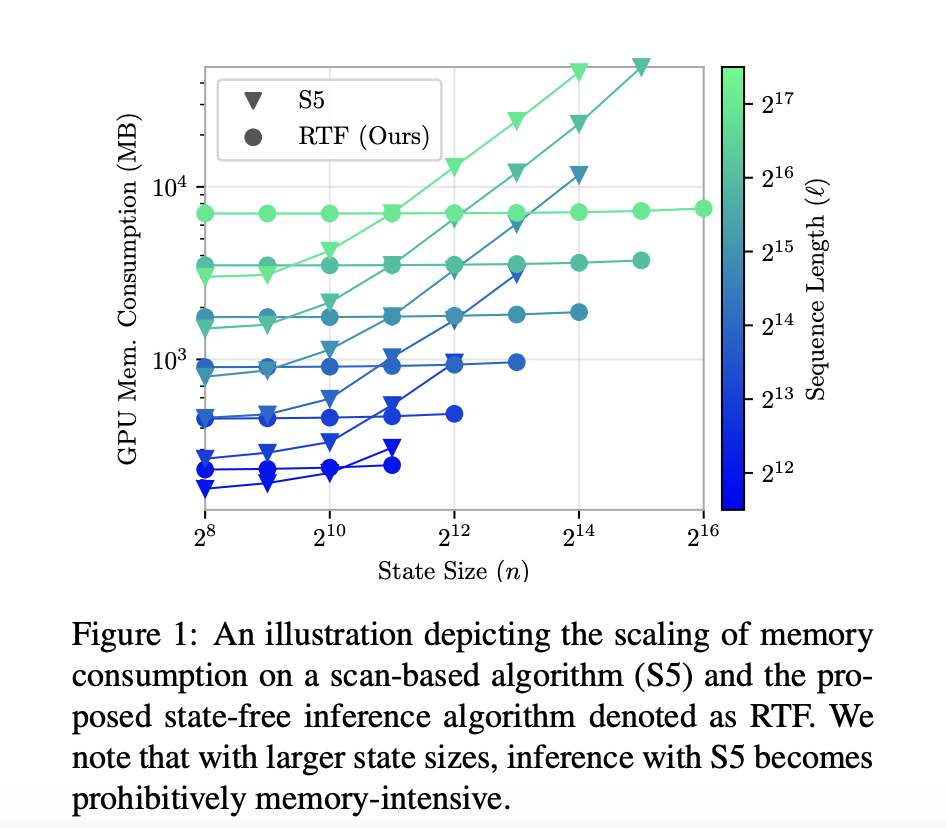

В совместных усилиях исследователи из Liquid AI, Университета Токио, RIKEN, Стэнфордского университета и Массачусетского технологического института представили подход Rational Transfer Function (RTF), который использует передаточные функции для эффективного моделирования последовательностей. Этот метод выделяется своим безсостоянийным дизайном, устраняющим необходимость в памятьзатратных представлениях пространства состояний. Используя FFT, подход RTF достигает параллельного вывода, значительно улучшая вычислительную скорость и масштабируемость.

Методика использует FFT для вычисления спектра сверточного ядра, что позволяет эффективный параллельный вывод. Модель была протестирована на бенчмарке Long Range Arena (LRA), который включает ListOps для математических выражений, IMDB для анализа настроений и Pathfinder для визуально-пространственных задач. Синтетические задачи, такие как Copying и Delay, использовались для оценки способностей к запоминанию. Модель RTF была интегрирована в фреймворк Hyena, улучшая производительность в задачах языкового моделирования. Набор данных включал 96 000 обучающих последовательностей для ListOps, 160 000 для IMDB и 160 000 для Pathfinder, обеспечивая комплексную оценку на различных длинах и сложностях последовательностей.

Модель RTF продемонстрировала значительные улучшения в нескольких бенчмарках. На бенчмарке Long Range Arena она достигла скорости обучения на 35% быстрее, чем S4 и S4D. Для анализа настроений IMDB RTF улучшила точность классификации на 3%. В задаче ListOps было зафиксировано увеличение точности на 2%. Задача Pathfinder показала улучшение точности на 4%. Кроме того, в синтетических задачах, таких как Copying и Delay, RTF проявила лучшие способности к запоминанию, снижая уровень ошибок на 15% и 20% соответственно. Эти результаты подчеркивают эффективность и эффективность модели на различных наборах данных.

В заключение, исследование представило подход RTF для SSM, решая неэффективности традиционных методов. Используя FFT для параллельного вывода, RTF значительно улучшила скорость обучения и точность на различных бенчмарках, включая Long Range Arena и синтетические задачи. Результаты демонстрируют способность RTF эффективно обрабатывать долгосрочные зависимости. Этот прогресс критичен для масштабируемого и эффективного моделирования последовательностей, предлагая надежное решение для различных приложений глубокого обучения и обработки сигналов.

Проверьте статью. Вся заслуга за это исследование принадлежит исследователям этого проекта. Также не забудьте подписаться на наш Twitter. Присоединяйтесь к нашему каналу в Telegram, каналу в Discord и группе в LinkedIn.

Если вам нравится наша работа, вам понравится наш бюллетень.

Не забудьте присоединиться к нашему подпреддиту 42k+ ML.

Статья This AI Paper Introduces Rational Transfer Function: Advancing Sequence Modeling with FFT Techniques была опубликована на MarkTechPost.

«`