«`html

Оптимизация больших языковых моделей с помощью Intel Labs

Большие языковые модели (LLM) стали незаменимыми для различных приложений обработки естественного языка, таких как машинный перевод и разговорный ИИ. Однако их сложность и размер создают проблемы с вычислительной эффективностью и потреблением памяти.

Проблемы с вычислительными ресурсами

Основная проблема LLM заключается в их огромных вычислительных требованиях. Обучение и дообучение этих моделей требуют миллиардов параметров, что ограничивает их доступность. Существующие методы, такие как параметрически эффективное дообучение (PEFT), лишь частично решают эту проблему, иногда ухудшая производительность.

Методология Intel Labs

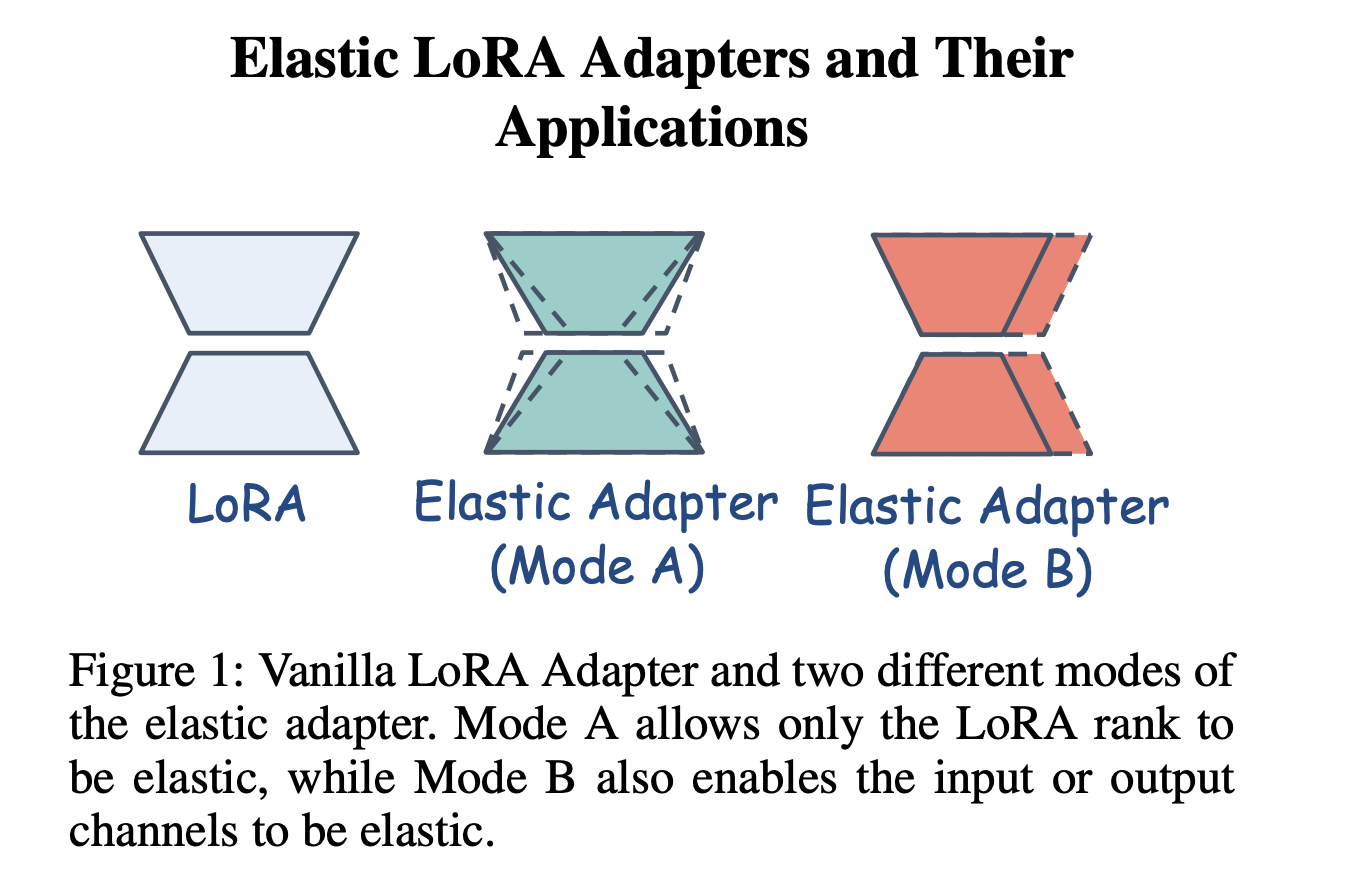

Исследователи Intel Labs разработали метод, который сочетает низкоранговую адаптацию (LoRA) с поиском нейронной архитектуры (NAS). Эта методология направлена на преодоление ограничений традиционных подходов к дообучению, повышая при этом эффективность и производительность.

Преимущества подхода LoNAS

Метод LoNAS позволяет селективно активировать подструктуры модели, что снижает избыточность и позволяет эффективнее настраивать модель, сохраняя при этом высокую скорость вывода. Исследования показали, что LoNAS увеличивает скорость вывода до 1.4x и уменьшает количество параметров модели на 80%.

Дальнейшие улучшения и стратегии

Были предложены новые стратегии, такие как Shears и SQFT, которые обеспечивают высокую точность модели, одновременно снижая количество активных параметров и улучшая эффективность дообучения.

Рекомендации по внедрению ИИ

Если вы хотите развивать свою компанию с помощью ИИ, следуйте этим рекомендациям:

- Проанализируйте, как ИИ может изменить вашу работу.

- Определите ключевые показатели эффективности (KPI), которые хотите улучшить с помощью ИИ.

- Выберите подходящее решение и внедряйте ИИ постепенно.

- Основываясь на данных и опыте, расширяйте автоматизацию.

Узнайте, как ИИ может изменить процесс продаж в вашей компании с решениями от saile.ru. Будущее уже здесь!

«`