Новая модель ИИ ‘bge-en-icl’: использование нескольких образцов для создания высококачественных текстовых вложений

Проблема:

Создание универсальных и качественных вложений текста для различных задач является значительным вызовом в обработке естественного языка (NLP). Существующие модели вложений часто сталкиваются с трудностями при обработке неизвестных задач и сложных операций поиска. Это препятствует их способности динамически адаптироваться к различным контекстам, что является критическим требованием для практических применений.

Решение и ценность:

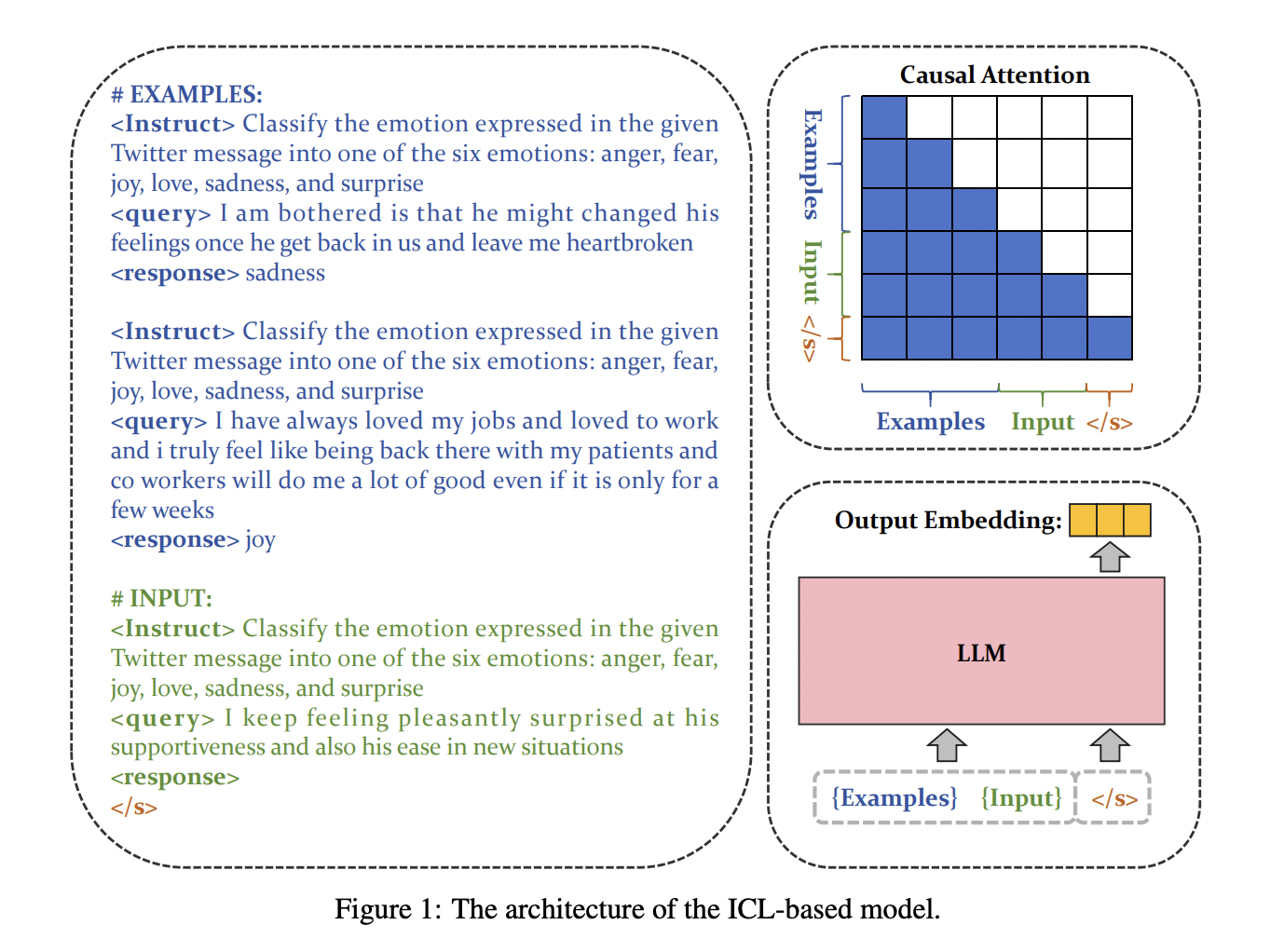

Новая модель ‘bge-en-icl’ улучшает генерацию текстовых вложений, используя возможности обучения в контексте (ICL) LLMs. Она интегрирует примеры, специфичные для задачи, непосредственно в запрос, что позволяет генерировать вложения, более релевантные и обобщаемые для различных задач. Этот подход обеспечивает высокую эффективность модели, устанавливая новые стандарты производительности на различных задачах без утраты способности модели адаптироваться к новым контекстам.

Преимущества ‘bge-en-icl’ модели:

— Основана на эффективной архитектуре Mistral-7B для задач NLP

— Использует обучение в контексте для создания обобщаемых вложений

— Тестируется на различных бенчмарках и показывает высокую производительность в сценариях обучения по нескольким образцам

Вывод: ‘bge-en-icl’ — инновационная модель, устанавливающая новые стандарты в генерации текстовых вложений. Ее преимущества включают высокую производительность на различных задачах и способность адаптироваться к новым контекстам, не утратив при этом простоты в архитектуре. Этот подход может значительно повлиять на исследования в области ИИ, предлагая путь к созданию более адаптивных и эффективных моделей для практических применений.